Den teknologiske udvikling har gennem de seneste årtier accelereret i en hidtil uset hastighed, og kunstig intelligens (AI) er en af de mest transformative teknologier i denne æra. AI bliver nu en integreret del af mange industrier og dagligdags applikationer, fra sundhedsvæsenet til finanssektoren og underholdningsindustrien. Denne stigende relevans har dog ført til voksende bekymringer omkring AI’s energiforbrug, i takt med at teknologien bliver mere udbredt og avanceret.

AI’s energiforbrug er blevet en nødvendig diskussion i både teknologiske og miljømæssige kredse. Det er vigtigt at forstå, hvordan AI’s energiforbrug kan påvirke både økonomi og miljø, især når vi ser på den store skala, hvorpå AI-applikationer opererer. Et eksempel på dette er sprogmodeller, der kræver enorme mængder data og computerkraft for at træne og fungere effektivt. Dette resulterer i betydelige mængder elektricitet, der skal til for at holde disse systemer kørende, hvilket kan have en stor indvirkning på energiforbruget i datacentre verden over.

AI og energiforbrug: En balancegang

Det er ikke kun de økonomiske omkostninger ved AI’s energiforbrug, der er bekymrende. Miljømæssigt er der også betydelige konsekvenser. Datacentre, som er hjertet i mange AI-systemer, bruger store mængder energi til både drift og køling af servere. Denne energibrug bidrager til CO2-udledninger, hvilket understreger behovet for at finde mere bæredygtige løsninger i AI-udvikling.

Som AI fortsætter med at vokse i kompleksitet og anvendelse, bliver det afgørende at tage højde for dens energiforbrug og de tilhørende miljømæssige konsekvenser. Diskussionen om AI’s energiforbrug er derfor ikke kun en teknisk nødvendighed, men også en etisk overvejelse, der kræver opmærksomhed fra både udviklere, politikere og forbrugere.

Faktorer, der påvirker AI’s energiforbrug

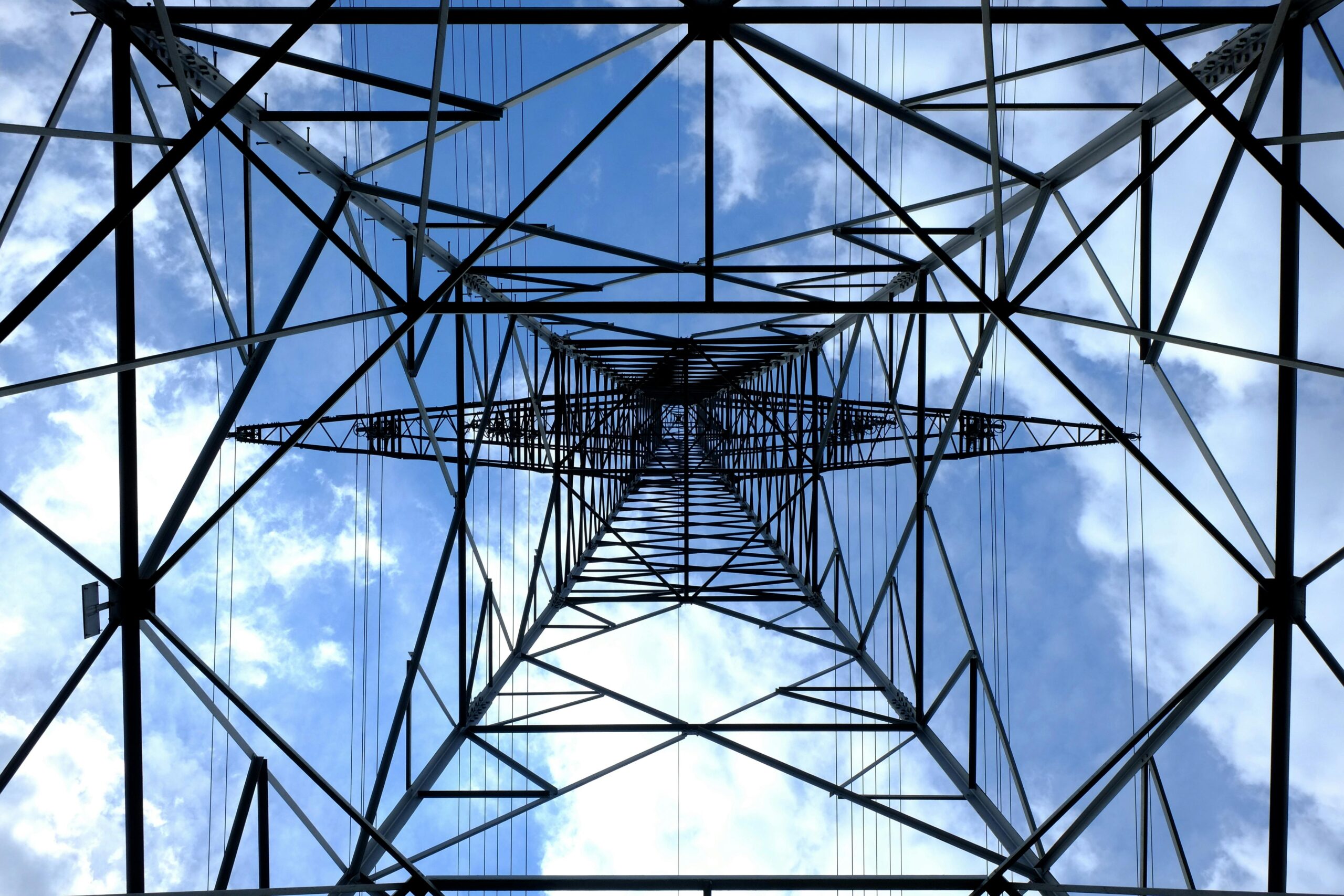

AI’s energiforbrug er i høj grad påvirket af de tekniske aspekter, der ligger til grund for teknologien. Datacentre spiller en central rolle i driften af AI-systemer, da de huser de servere, der udfører de komplekse beregninger, som er nødvendige for at træne og køre AI-modeller. Disse datacentre kræver betydelige mængder elektricitet, ikke kun til at drive serverne, men også til at køle dem ned, hvilket kan udgøre op til 40% af det samlede energiforbrug i et datacenter.

Derudover varierer energibehovet afhængigt af typen af AI-applikation. For eksempel kræver dyb læring, som ofte anvender store neurale netværk, betydeligt mere energi end mere simple maskinlæringsmodeller. Dette skyldes, at dyb læring involverer intensive beregninger og store mængder data, hvilket øger belastningen på datacentre.

Data fra aktuelle undersøgelser og rapporter

Flere undersøgelser har fremhævet det stigende energiforbrug i forbindelse med AI. En rapport fra Massachusetts Institute of Technology (MIT) påpeger, at træningen af store sprogmodeller kan udlede mere CO2 end fem biler i deres levetid. Denne statistik understreger den betydelige miljøpåvirkning, som AI-teknologier kan have.

En anden undersøgelse fra OpenAI viser, at energiforbruget til træning af AI-modeller er fordoblet hvert halve år siden 2012. Dette skyldes i høj grad den stigende kompleksitet og størrelse af de modeller, der udvikles i dag. Grafiske repræsentationer af disse data viser en eksponentiel vækst i energiforbrug, hvilket fremhæver behovet for bæredygtige løsninger.

Industriens respons på energiforbruget

Tech-industrien er begyndt at tage skridt for at reducere AI’s energiforbrug. Mange virksomheder arbejder på at optimere deres algoritmer for at gøre dem mere energieffektive. Dette kan involvere brugen af mere effektive beregningsmetoder eller reduktion af mængden af data, der er nødvendig for at træne modeller.

Derudover er der en stigende interesse for at anvende grøn energi i datacentre. Google og Microsoft er blandt de virksomheder, der har forpligtet sig til at drive deres datacentre med 100% vedvarende energi inden for de næste par år. Sådanne initiativer er afgørende for at reducere AI’s samlede CO2-aftryk.

Vigtigheden af bæredygtige løsninger inden for AI-udvikling kan ikke undervurderes. Ved at kombinere teknologiske fremskridt med miljømæssige hensyn kan industrien fortsætte med at innovere uden at skade planeten. Det er en balancegang, der kræver samarbejde mellem forskere, virksomheder og politikere for at sikre en bæredygtig fremtid for AI-teknologier.

Fremtidsperspektiver for AI og energiforbrug

AI’s energiforbrug er et emne, der fortsat vil være i fokus i takt med teknologiens udvikling. Fremtidens AI-systemer vil sandsynligvis blive endnu mere komplekse og kræve større datamængder, hvilket kan øge energibehovet yderligere. Det er derfor afgørende, at der udvikles nye teknologier og metoder, der kan hjælpe med at reducere energiforbruget.

En mulig udvikling er brugen af kvantecomputere, som kan udføre beregninger langt hurtigere og mere effektivt end traditionelle computere. Dette kan potentielt reducere energiforbruget betydeligt, men teknologien er stadig i sin vorden og kræver yderligere forskning og udvikling.

Politikere og økonomiske faktorer spiller også en vigtig rolle i reguleringen af AI’s energiforbrug. Der kan være behov for nye lovgivninger og incitamenter, der fremmer udviklingen og anvendelsen af mere energieffektive teknologier. Samtidig kan økonomiske tilskyndelser til brug af vedvarende energi i datacentre bidrage til at reducere AI’s samlede miljømæssige fodaftryk.

Afsluttende tanker

AI’s energiforbrug er en kompleks problemstilling, der kræver en afbalanceret tilgang. På den ene side er der behovet for teknologisk fremskridt og innovation, som AI kan tilbyde, og på den anden side er der de miljømæssige hensyn, der følger med det øgede energiforbrug. Det er vigtigt at finde en balance mellem disse to aspekter for at sikre en bæredygtig fremtid for AI-teknologier.

Ved at fortsætte med at udvikle og implementere energieffektive løsninger og vedvarende energikilder kan vi mindske AI’s miljøpåvirkning. Samtidig er det afgørende, at politikere, virksomheder og forskere arbejder sammen for at fremme bæredygtige løsninger, der kan understøtte en ansvarlig udvikling af AI.

Ofte stillede spørgsmål

Hvor meget strøm bruger en typisk AI-applikation?

Energiforbruget for en AI-applikation varierer afhængigt af dens kompleksitet og anvendelse. For eksempel kan træningen af en stor sprogmodel forbruge mere energi end fem biler i deres levetid, hvilket demonstrerer den betydelige mængde strøm, der kræves.

Hvordan kan AI’s energiforbrug reduceres?

AI’s energiforbrug kan reduceres ved at optimere algoritmer for energieffektivitet, anvende kvantecomputere, og ved at bruge vedvarende energikilder i datacentre. Derudover kan reduktion af datamængder og mere effektive beregningsmetoder også bidrage til at mindske energibehovet.

Hvad er de miljømæssige konsekvenser af AI’s energiforbrug?

AI’s energiforbrug kan føre til betydelige CO2-udledninger, især hvis strømmen kommer fra fossile brændstoffer. Dette kan bidrage til klimaforandringer og miljøforringelse, hvilket understreger behovet for bæredygtige løsninger.

Er der nogen politiske tiltag for at regulere AI’s energiforbrug?

Der er begyndende politiske tiltag for at regulere AI’s energiforbrug, herunder incitamenter til brug af vedvarende energi og udvikling af energieffektive teknologier. Disse tiltag kan hjælpe med at reducere AI’s miljømæssige påvirkning og fremme bæredygtig teknologiudvikling.